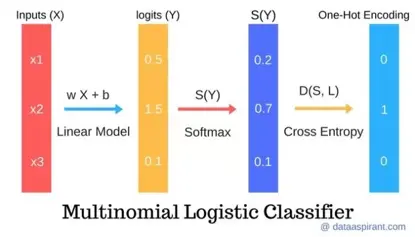

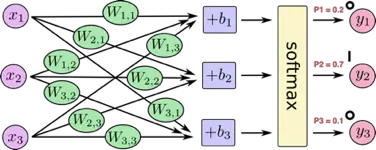

Softmax 回归是一种基于监督学习的分类算法,它是逻辑回归在多分类上的推广。它通过 Softmax 将线性输出层的结果进行归一化,分别表示不同分类的概率,并且所有概率之和为1。

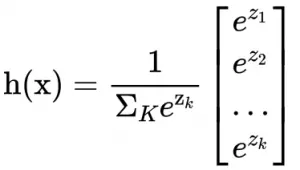

Softmax 回归假设式(hypothesis):

其中 z 是线性输出层 即 z = wX + b

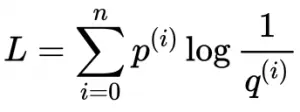

交叉熵(cross-entropy):

其中p表示真实概率分布,q表示非真实概率分布;交叉熵可用于衡量真实标记的分布与预测标记的分布的差异程度。

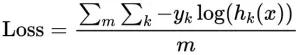

Softmax 以交叉熵作为损失函数:

其中 m 表示样本数,k 表示分类数,如果某样本属于第 k 类,则 y_k =1,其余情况为0,h_k 表示某样本属于第 k 类的概率。

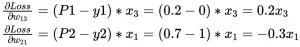

梯度计算:

解释:模型误差相对于第 k 类的第 j 个特征的权重的梯度 =(样本属于第 k 类的概率 – 该样本是否属于第k类(0或1)) x 样本第 j 个特征的值。

例如: 某样本(x1, x2, x3)标记为第2类

什么时候用逻辑回归、什么时候用Softmax回归?

如果类别是互斥的,用Softmax,例如:香蕉、苹果、西瓜;

如果类别不互斥的,用多个逻辑回归,例如:黑白图片、户外图片、包含人的图片